Zuckerberg di Meta ‘L’IA è forse la tecnologia fondamentale più importante del nostro tempo

Zuckerberg di Meta 'L'IA è fondamentale nel nostro tempo

Il fondatore e amministratore delegato di Meta, Mark Zuckerberg, ha tenuto mercoledì una presentazione con il team del gruppo di intelligenza artificiale dell’azienda, incluso il pioniere del deep learning Yann LeCun, sul tema “Costruire per il metaverso con l’intelligenza artificiale”.

La presentazione è disponibile sulla pagina Facebook del laboratorio di intelligenza artificiale.

La proposta del laboratorio di intelligenza artificiale, visualizzata sulla sua pagina Facebook, è “Attraverso il potere dell’intelligenza artificiale, permetteremo un mondo in cui le persone possono condividere, creare e connettersi facilmente fisicamente e virtualmente con chiunque, ovunque.”

Zuckerberg ha definito l’intelligenza artificiale “forse la tecnologia fondamentale più importante del nostro tempo”.

Zuckerberg ha annunciato qualcosa chiamato “Project CAIRaoke”, che Zuckerberg ha descritto come “un modello neurale completo end-to-end per la costruzione di assistenti su dispositivi. Combina l’approccio dietro BlenderBot con le ultime tecnologie di intelligenza artificiale conversazionale per offrire capacità di dialogo migliori.”

- Il guru dell’IA di Meta, LeCun La maggior parte degli approcc...

- Meta svela il suo primo chip AI personalizzato

- Il critico di IA Gary Marcus LeCun di Meta sta finalmente convergen...

Ha detto che il focus dell’azienda nell’ambito dell’IA per il metaverso consiste in due aree di ricerca sull’IA: “Percezione egocentrica” e “una nuova classe di modelli generativi di IA”, come ha spiegato Zuckerberg.

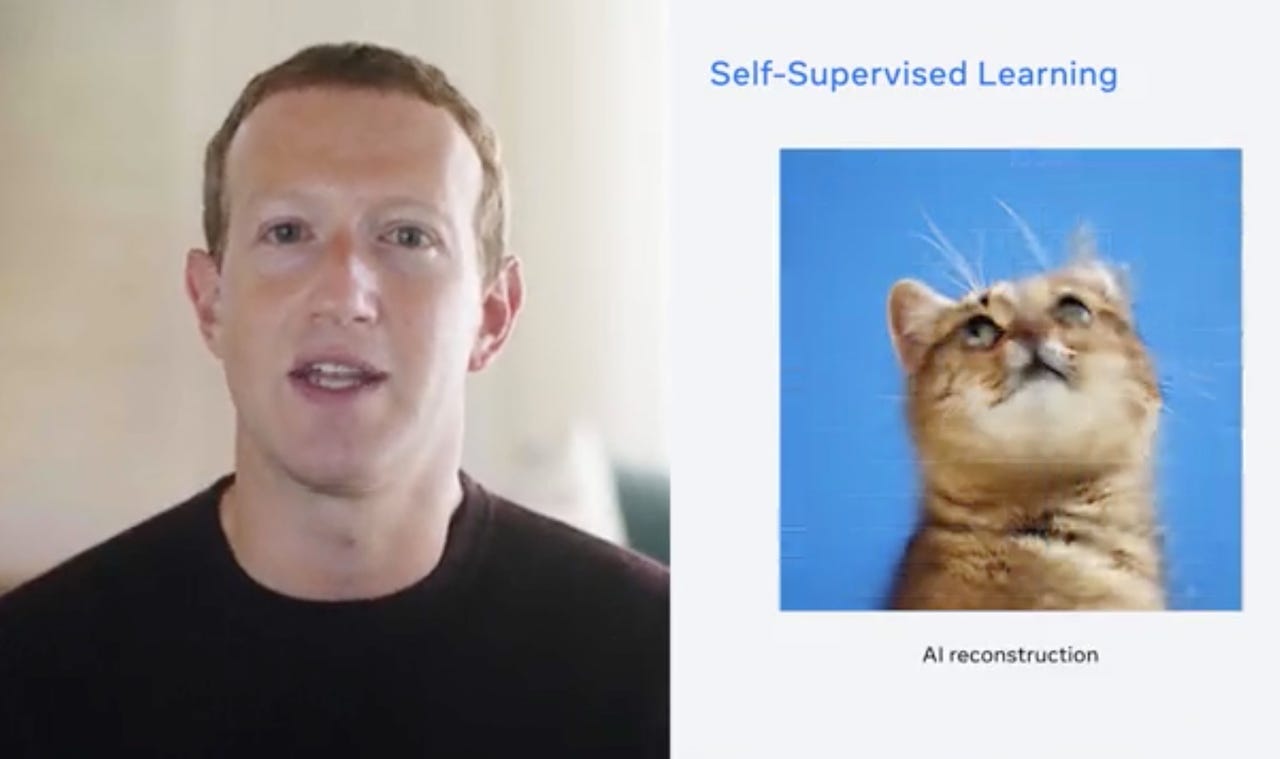

Spiegazione di Meta sull’apprendimento autosupervisionato.

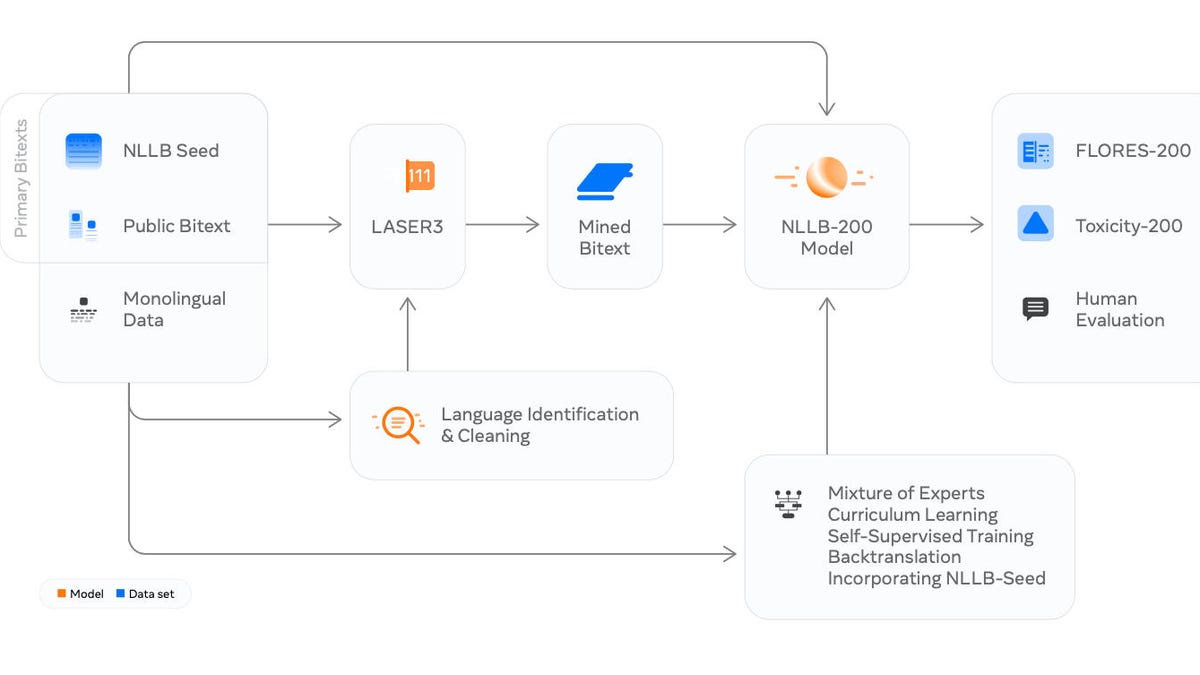

Zuckerberg ha annunciato “nessuna lingua lasciata indietro”, che porterà a “un singolo modello in grado di comprendere centinaia di lingue”.

Ha anche annunciato quello che ha chiamato “un traduttore vocale universale” che offrirà traduzioni istantanee. “L’IA consegnerà questo entro la nostra vita”, ha detto Zuckerberg.

La presentazione della giornata si è concentrata sul tema dell’apprendimento autosupervisionato, in cui una rete neurale viene sviluppata accumulando molti più dati senza etichette applicate attentamente. Lecun ha spiegato a Eliza Strickland di IEEE Spectrum i vantaggi dell’apprendimento autosupervisionato in un’email pubblicata martedì.

Dopo l’introduzione di Zuckerberg, Jérôme Pesenti, il leader del team di intelligenza artificiale, ha spiegato che i modelli autosupervisionati stanno sempre più raggiungendo i modelli neurali addestrati supervisionati, non solo nei modelli linguistici ma anche in aree come il riconoscimento delle immagini.

In un video preparato, il Project CAIRaoke è stato presentato come un assistente intelligente più intelligente che capirebbe correttamente i comandi vocali. Il video ha preso in giro i comuni problemi della tecnologia degli assistenti, come quando comprende completamente male la richiesta dell’utente, che ha definito “livello 2”, o assistenti “meccanici” utili per “interazioni in un solo colpo”, ma non per “interazioni multiple”.

Meta, secondo la presentazione, produrrà assistenti “potenziati”.

Nella parte finale della presentazione della giornata, LeCun è stato raggiunto dal collega pioniere del deep learning Yoshua Bengio in una conversazione ospitata da Lex Fridman, per una discussione sul cammino verso “un’intelligenza di livello umano”.

Bengio ha affermato che “siamo ancora lontani dall’intelligenza artificiale di livello umano”. Bengio ha osservato che gli esseri umani “prestano attenzione” a situazioni nuove e impiegano tempo per ragionare su un problema. “Possiamo trarre ispirazione da come il cervello lo fa”, ha detto, incluso “il processo cosciente”.

Bengio ha usato come esempio una persona che impara a guidare sul lato sinistro della strada per la prima volta durante una visita a Londra. Gran parte dell’apprendimento è reso possibile, ha detto, dal fatto che gli esseri umani hanno molte informazioni coerenti e familiari e sono in grado di riformare le abitudini per adattarle agli elementi nuovi.

LeCun, pur concordando con Bengio sui problemi da affrontare, ha detto: “Sono più focalizzato sulle soluzioni”. Ha citato l’apprendimento umano e animale attraverso pochi esempi. “Che tipo di apprendimento usano gli esseri umani e gli animali che non siamo in grado di riprodurre nelle macchine? Questa è la grande domanda che mi pongo”, ha detto LeCun.

Da sinistra, l’ospite Lex Fridman, Yann LeCun, Yoshua Bengio.

“Penso che ciò che manca sia la capacità degli esseri umani e degli animali di imparare come funziona il mondo, di avere un modello del mondo”, ha detto LeCun. Ha fatto riferimento all’esempio di Bengio sulla guida sul lato sinistro. “Le regole della fisica non cambiano”, come girare il volante di una macchina. “Come possiamo far sì che le macchine imparino modelli del mondo, come funziona il mondo, principalmente attraverso l’osservazione, per capire cose molto basilari sul mondo.”

“Il buon senso è una collezione di modelli del mondo”, sostiene LeCun.