Intelligenza artificiale generativa potrebbe minare le elezioni negli Stati Uniti e in India, secondo uno studio

Uno studio afferma che l'intelligenza artificiale generativa potrebbe influenzare le elezioni negli Stati Uniti e in India.

I generatori di immagini AI potrebbero compromettere le prossime elezioni nelle democrazie più grandi del mondo, secondo una nuova ricerca

Logically, una startup britannica di fact-checking, ha indagato sulla capacità dell’AI di produrre immagini false sulle elezioni in India, negli Stati Uniti e nel Regno Unito. Ognuno di questi paesi si recherà presto alle urne.

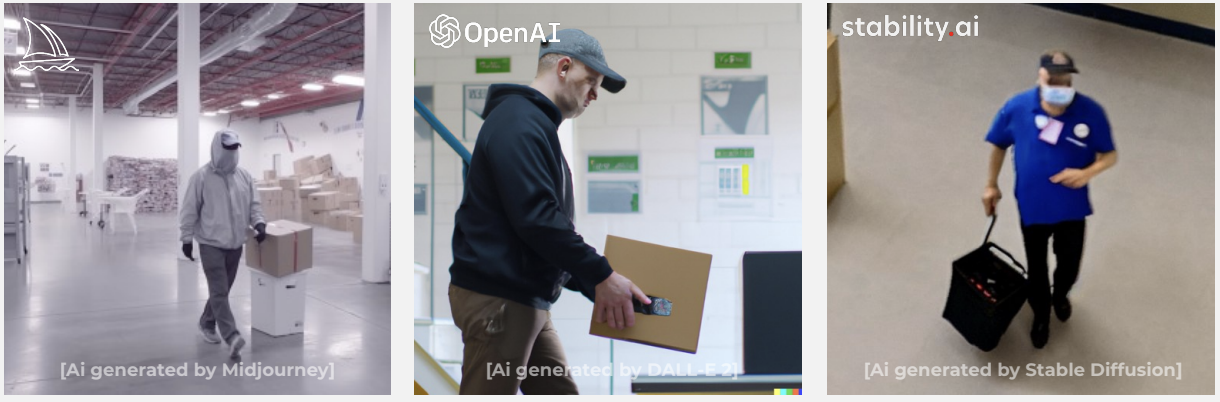

L’azienda ha testato tre popolari sistemi AI generativi: Midjourney, DALL-E 2 e Stable Diffusion. Tutti hanno una moderazione dei contenuti in qualche forma, ma i parametri non sono chiari.

Logically ha esplorato come queste piattaforme potrebbero supportare campagne di disinformazione. Ciò includeva testare narrazioni su una “elezione rubata” negli Stati Uniti, migranti che “inondano” il Regno Unito e partiti che hackerano le macchine elettorali in India.

Nei tre sistemi, più dell’85% dei prompt è stato accettato. La ricerca ha scoperto che Midjourney aveva la moderazione dei contenuti più forte e ha prodotto immagini di migliore qualità. DALL-E 2 e Stable Diffusion avevano una moderazione più limitata e generavano immagini di qualità inferiore.

- Migliori offerte Apple della settimana prezzi più bassi dell’...

- Il MacRumors Show Il nostro piano per sistemare le linee di prodott...

- I consumatori europei ritengono che la società non sia pronta per l...

Dei 22 racconti sull’elezione negli Stati Uniti testati, il 91% è stato accettato da tutte e tre le piattaforme al primo tentativo di prompt. Midjourney e DALL-E 2 hanno respinto i prompt che cercavano di creare immagini di George Soros, Nancy Pelosi e un nuovo annuncio di pandemia. Stable Diffusion ha accettato tutti i prompt.

La maggior parte delle immagini era lontana dall’essere fotorealistica. Ma Logically afferma che anche immagini grezze possono essere utilizzate in modo malizioso.

Logically ha chiesto una maggiore moderazione dei contenuti sulle piattaforme. Vuole anche che le aziende di social media siano più proattive nel contrastare la disinformazione generata dall’AI. Infine, l’azienda raccomanda di sviluppare strumenti che identifichino comportamenti maliziosi e coordinati.

Alcuni cinici potrebbero notare che Logically potrebbe trarre beneficio da queste misure. La startup ha precedentemente svolto verifiche dei fatti per il governo del Regno Unito, agenzie federali degli Stati Uniti, la commissione elettorale indiana, Facebook e TikTok. Tuttavia, la ricerca mostra che l’AI generativa potrebbe amplificare narrazioni false sulle elezioni.