IA Generativa Rigurgito di Dati di Addestramento o Remixer Creativi?

Le capacità di mimetizzazione dell'Intelligenza Artificiale Generativa hanno causato controversie tra i creatori, suscitando preoccupazioni sulla validità della difesa del fair use del copyright.

“`html

Il rifacimento di American Pie peggiora la disputa sul copyright di GenAI

🎵 Don McClean ha sempre dovuto condividere “American Pie”. Sin dal suo rilascio nel 1971, la famosa canzone è riemersa in cover di Madonna, parodie di Weird Al Yankovic, serenate dei presidenti 🇰🇷 sudcoreani, sottotrame nei film Marvel e persino tecniche di tortura della CIA. Ma oggi, gli imitatori principali di McClean non sono nemmeno umani. 🤖

Puoi interrogare i colpevoli tu stesso. Basta caricare ChatGPT di OpenAI e chiedere al generatore di testo di “scrivere i testi di una canzone sul giorno in cui la musica è morta”. Inevitabilmente, l’output dello strumento restituirà testi o temi di “American Pie” – e talvolta persino lo stesso ritornello.

Questa rigurgitazione emerge nonostante il comando non abbia chiesto di “American Pie” o della storia che l’ha ispirata – l’incidente aereo del 1959 che ha ucciso i pionieri del rock and roll Buddy Holly, Ritchie Valens e The Big Bopper.

L’algoritmo del remix

È ulteriore prova che ChatGPT non può creare nulla di veramente originale. Piuttosto, il sistema è più simile a un algoritmo di remix. La vera creatività sta nei suoi dati di addestramento, prelevati dal web senza consenso. 😮

- Mistral AI presenta Mistral Large un nuovo protagonista nel gioco d...

- OpenAI e The New York Times si scontrano in una causa per violazion...

- Il Nuovo Modello Gemini di Google Una Delusione per i Programmatori

Il dottor Max Little, un esperto di intelligenza artificiale presso l’Università di Birmingham, descrive lo strumento come una “macchina di violazione del copyright”. Si sbeffeggia di qualsiasi suggerimento che i grandi modelli di linguaggio (LLM) siano creativi in modo indipendente.

“Non è così perché non possono produrre nulla affatto senza essere addestrati su quantità astronomiche di testo,” dice Little a TNW.

È un approccio ubiquitario nell’AI generativo. Studi rigorosi hanno dimostrato che i LLM possono rigurgitare grandi porzioni del testo di addestramento originale, compresi paragrafi verbatim da libri e poesie. Proprio la scorsa settimana, un report ha scoperto che il 60% degli output di GPT-3.5 di OpenAI conteneva plagio.

Né il problema si applica unicamente ai generatori di testo. Dalle immagini di Stable Diffusion alle musiche di Google Lyria e al codice di GitHub Copilot, gli strumenti GenAI mediante diverse modalità possono produrre output di qualità sbalorditiva – e familiarità inquietante.

La minaccia alle industrie creative

La loro imitazione rappresenta una minaccia esistenziale per le industrie creative. Rappresenta anche una minaccia per l’industria di GenAI.

Gli artisti affermano che la marcia incessante di GenAI sta calpestando le loro convenzioni sul copyright. Non sorprende che le aziende tech siano in disaccordo. Le loro difese di solito invocano la dottrina del “fair use”.

I dettagli variano a seconda della giurisdizione, ma un principio centrale del “fair use” è che gli output hanno uno scopo e un carattere “trasformativo”. Piuttosto che limitarsi a copiare o riprodurre i loro dati di addestramento, aggiungono qualcosa di nuovo e significativo. Almeno, questo è ciò che sostengono i leader di GenAI in tribunale.

Stability AI, la startup con sede nel Regno Unito dietro al generatore di immagini Stable Diffusion, ha sostenuto tale argomentazione lo scorso anno presso l’Ufficio del Copyright degli Stati Uniti. Anche OpenAI ha citato la dottrina in una recente mozione per respingere due cause collettive.

Diversi autori, tra cui la comica Sarah Silverman e la scrittrice canadese Mona Awad, avevano citato in giudizio l’azienda per aver addestrato LLM su set di dati acquisiti illegalmente.

Poiché il loro lavoro è stato integrato in ChatGPT, hanno affermato che lo strumento stesso era un “lavoro derivato” coperto dal copyright.

OpenAI ha respinto la pretesa. Secondo il team legale della startup, “l’uso di materiali protetti da copyright da parte degli innovatori in modi trasformativi non viola il copyright”. Un giudice ha anche respinto l’accusa che ogni output di ChatGPT sia derivativo.

Ma quando gli output sono identici ai loro dati di addestramento, le acque legali iniziano a diventare torbide. La riproduzione è una base dubbia per la trasformazione. È anche un fenomeno comune.

Il Punto di Svolta

Oltre ai “American Pies”, gli strumenti GenAI hanno rigurgitato scene di film, personaggi dei cartoni animati, videogiochi, design di prodotti e codice.

Hanno anche copiato giornali – il che potrebbe portare a un punto di svolta.

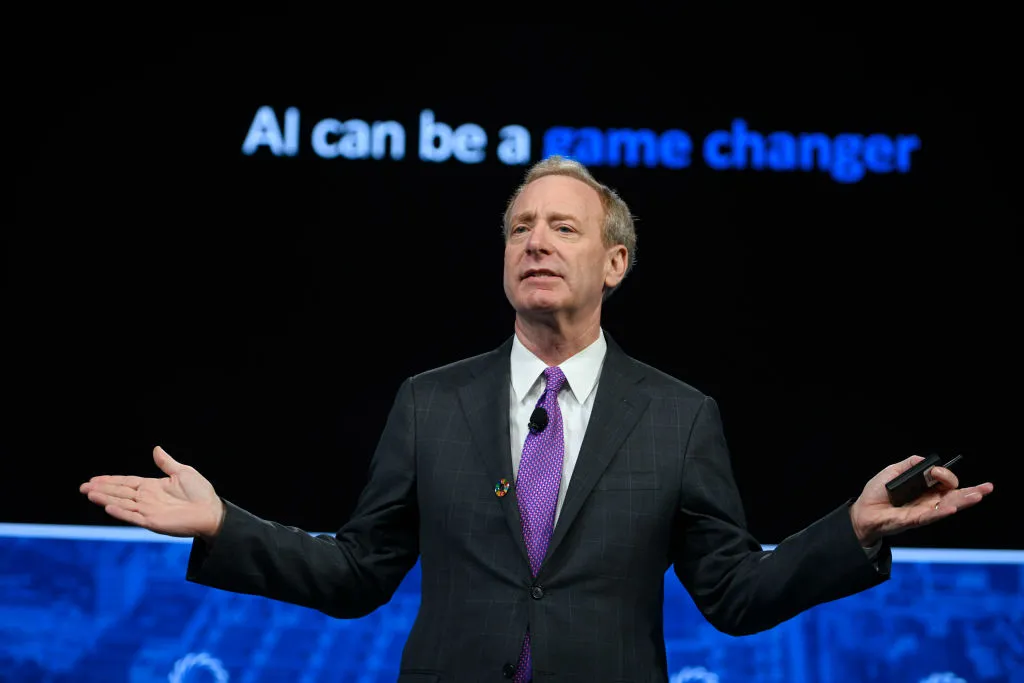

A dicembre, il New York Times ha citato in giudizio OpenAI e il suo partner commerciale Microsoft. Il giornale sostiene che l’uso non autorizzato dei suoi articoli nei dati di addestramento violi i diritti di proprietà intellettuale (IP). Gli esperti legali descrivono la causa come “il miglior caso finora che afferma che l’intelligenza artificiale generativa è una violazione del copyright”.

Gli avvocati del NYT hanno evidenziato la “sostanziale somiglianza” tra i contenuti dell’outlet e gli output di ChatGPT. Per sostenere la pretesa, hanno fornito 100 esempi del bot che riproduceva le notizie del giornale.

“““html

“La loro causa mette in discussione un altro aspetto chiave del “fair use”: l’impatto sul mercato del lavoro originale.

La Battaglia sul Copyright

Secondo i querelanti, OpenAI non solo replica i contenuti del NYT ma sfrutta anche i contenuti per competere negli stessi mercati. Allo stesso tempo, l’azienda devia il traffico dal sito web del giornale.

Come prova, essi indicano Browse con Bing, una funzione premium alimentata dalla stessa tecnologia alla base di ChatGPT. Lo strumento può riassumere le raccomandazioni sui prodotti fatte dai revisori del NYT. Offrendo agli utenti queste informazioni, gli avvocati hanno detto che OpenAI rimuove il loro incentivo a visitare l’articolo originale. Ciò significa anche che non fanno clic sui collegamenti ai prodotti che generano entrate per l’editore.

“Non c’è nulla di ‘trasformativo’ nell’usare i contenuti del The Times senza pagamento per creare prodotti che sostituiscono il The Times e rubano il pubblico da esso”, ha dichiarato la denuncia.

Naturalmente, i giganti di GenAI sono in disaccordo.

OpenAI ha risposto alla denuncia con un post riprovevole sul blog. L’azienda sospetta che il NYT abbia o “istruito il modello a rigurgitare” o “selezionato attentamente i loro esempi tra molti tentativi”.

Gli addetti del settore concordano. Daniel Jeffries, chief intelligence officer di Stability AI, ha descritto le richieste nella denuncia come “chiaramente manipolate”. Ha detto che le copie sono state prodotte “quasi certamente” tramite una tecnica chiamata recupero aumentato generativo (RAG), che ottimizza le uscite LLM accedendo a fonti esterne di informazioni.

La Question della Contaminazione AI

Qualunque sia il metodo, OpenAI ha detto che il rigurgito è un “difetto raro” che l’azienda sta “lavorando per portare a zero”. Ma i critici pongono domande sui poteri dei meccanismi preventivi.

Poco indica il processo di riproduzione di ChatGPT di “American Pie”.

“A volte, l’infrazione diretta del diritto d’autore in modo letterale… viene rilevata dall’algoritmo e viene presentato un avviso”, dice.

“Tuttavia, l’algoritmo può ancora facilmente essere portato a produrre uscite che sono chiaramente plagiati dai dati di addestramento, come in questo caso, il tema dei testi è sempre l’evento del crash del 1959 di Holly/Valens/Bopper”.

Per quanto raro possa essere in ChatGPT, il rigurgito è diffuso negli strumenti GenAI. Quando essi replicano in modo dimostrabile i loro dati di addestramento e poi competono nello stesso mercato, le fondamenta del fair use appaiono traballanti.

Ben Maling, managing associate presso lo studio legale sulla proprietà intellettuale EIP, sta monitorando da vicino l’instabilità. Le uscite che sono copie verbali o derivate dei loro dati di addestramento minacciano un “altra possibile violazione del diritto d’autore”, avverte. Sia il sistema che l’utente finale potrebbero essere responsabili per i danni.

“Molti dei grandi fornitori di AI sono così preoccupati per il potenziale di questa situazione da far scappare i clienti che stanno offrendo [assicurazioni] promettendo di difenderli contro azioni per violazione del diritto d’autore”, ha detto Maling a TNW via e-mail.

Il Dilemma di GenAI

Non è l’unica prova di preoccupazione da parte di OpenAI. Il mese scorso, il portabandiera di GenAI ha detto al Parlamento britannico che è “impossibile” creare strumenti AI come ChatGPT senza materiale coperto da copyright. Alla ricerca di protezione legale, l’azienda ha chiesto un’esenzione speciale per la pratica.

La richiesta ha alimentato le paure intorno ai dati di addestramento regurgitati.

Se i politici esentassero OpenAI, la startup “sarebbe libera di copiare e remixare qualsiasi testo originale da qualsiasi parte e in qualsiasi momento”, dice Little. Di conseguenza, rischiano di “distruggere le industrie creative che dipendono dal copyright per esistere.”.

Un Trattamento per il Rigurgito

Il rigurgito di GenAI non è necessariamente terminale. Gli analisti hanno prescritto numerose cure per questa scomoda affezione.

Una è stata creata da Ed Newton-Rex, il precedente vice presidente audio di Stability AI. Durante il suo periodo alla start-up, Newton-Rex ha sviluppato Stable Audio, un generatore musicale addestrato su contenuti con licenza. Il trentaseienne vuole che altre aziende seguano il suo esempio.

“Potresti rallentare un po’ l’industria dell’IA perché dovrebbero andare a spendere più tempo, più denaro e più sforzi sulle licenze”, Newton-Rex racconta a TNW. “Ma nel processo, francamente, salveresti le industrie creative. Penso che ci sia una minaccia esistenziale qui.”

Gli artisti che affrontano questa minaccia hanno applicato una cura più estrema: il veleno.

Il metodo di erogazione più popolare è uno strumento chiamato Nightshade. Questo software “avvelena” i dati di addestramento applicando cambiamenti invisibili alle immagini. Quando le aziende raschiano le creazioni senza consenso, possono sconvolgere le uscite del modello AI.

“““html

Il metodo si è dimostrato popolare. Entro cinque giorni dal lancio, Nightshade ha superato le 250.000 download.

Tuttavia, Little si aspetta che l’IA continui a rigurgitare American Pies. Dubita che gli strumenti addestrati sul contenuto creativo “raschiato” possano mai sfuggire al problema del plagio. “Perché, per definizione,” dice, “sono solo algoritmi che remixano i loro dati di addestramento.”

Uno dei temi dell’edizione di quest’anno della Conferenza TNW è Ren-AI-ssance: Il Rinascimento Alimentato dall’IA. Se vuoi approfondire tutto ciò che riguarda l’intelligenza artificiale o semplicemente partecipare all’evento (e salutare il nostro team editoriale), abbiamo qualcosa di speciale per i nostri lettori fedeli. Utilizza il codice TNWXMEDIA al momento del pagamento per ottenere il 30% di sconto sul tuo pass business, investitore o sui pacchetti per le startup (Bootstrap & Scaleup).

Q&A: Preoccupazioni riguardo all’IA generativa e al copyright dei dati di addestramento

Q: Gli strumenti GenAI possono creare qualcosa di veramente originale?

A: No, non possono. Gli strumenti GenAI, come il ChatGPT di OpenAI, sono come algoritmi di remix. Si basano pesantemente sui dati di addestramento raschiati da internet senza consenso, e il loro output spesso riproduce ampi frammenti del testo originale di addestramento.

Q: Cos’è il concetto di “fair use” e come si relaziona all’uso dell’IA di GenAI di materiale coperto da copyright?

A: Il concetto di “fair use” è un concetto legale che consente l’uso di materiale coperto da copyright in determinate circostanze, ad esempio per scopi trasformativi. Le aziende GenAI sostengono che il loro uso del materiale coperto da copyright sia trasformativo e aggiunga qualcosa di nuovo e significativo.

Q: Ci sono prove che gli strumenti GenAI stiano riproducendo contenuti coperti da copyright?

A: Sì, ci sono stati casi in cui gli strumenti GenAI hanno riprodotto contenuti coperti da copyright senza autorizzazione. Ad esempio, il New York Times ha citato in giudizio OpenAI e Microsoft, sostenendo che i loro articoli fossero utilizzati nei dati di addestramento senza permesso.

Q: In che modo la riproduzione di contenuti coperti da copyright da parte di GenAI influisce sugli autori originali?

A: La riproduzione di contenuti coperti da copyright da parte di GenAI può danneggiare gli autori originali deviando il traffico lontano dal loro lavoro e competendo nello stesso mercato. Questo può potenzialmente causare perdite finanziarie agli autori e un incentivo diminuito per il pubblico di visitare il contenuto originale.

Q: Come stanno rispondendo le aziende GenAI alle accuse di violazione del copyright?

A: Le aziende GenAI, come OpenAI, hanno difeso il loro utilizzo del materiale coperto da copyright sostenendo che rientra nel fair use e che stanno creando prodotti trasformativi. Tuttavia, c’è un dibattito in corso e azioni legali legate a queste affermazioni.

Q: Quali rimedi o trattamenti sono stati proposti per affrontare il problema della riproduzione di materiale coperto da copyright da parte di GenAI?

A: Un trattamento proposto è quello di concedere in licenza i contenuti utilizzati per addestrare i modelli GenAI. Ciò richiederebbe alle aziende di IA di dedicare più tempo e risorse alla licenza, ma potrebbe aiutare a proteggere le industrie creative. Un altro approccio è il “poisoning” dei dati di addestramento, che interrompe gli output dei modelli IA quando si verifica un uso non autorizzato.

Riferimenti:

- Il Dott. esperto di IA Max Little sul plagio del ChatGPT

- Ricerca sul rigurgito del testo di addestramento di LLMs

- Rapporto sugli output di GPT-3.5 di OpenAI contenenti plagio

- Argomentazione di Stability AI per il fair use con Stable Diffusion

- Cause del New York Times contro OpenAI e Microsoft

- Strumento Nightshade per disturbare i modelli IA

“`