Microsoft presenta PyRIT Uno Strumento per Identificare i Rischi nei Sistemi AI Generativi

PyRIT può generare migliaia di prompt maligni per testare un modello di IA generativa e valutare la sua risposta

“`html

Microsoft condivide il suo strumento di sicurezza AI con il pubblico

Nonostante le avanzate capacità dei modelli AI generativi, abbiamo visto molti casi in cui “fanno impazzire”, o hanno falle che attori malintenzionati possono sfruttare. Per aiutare a mitigare questo problema, Microsoft sta presentando uno strumento che può aiutare a identificare i rischi nei sistemi AI generativi.

Giovedì, Microsoft ha rilasciato il Python Risk Identification Toolkit per l’AI generativa (PyRIT), uno strumento che il team di sicurezza AI di Microsoft ha utilizzato per verificare i rischi nei suoi sistemi AI gen, inclusa Copilot.

Una nuova era di identificazione dei rischi per i sistemi AI generativi

Nell’ultimo anno, Microsoft ha sottoposto a test più di 60 sistemi AI gen di alto valore, da cui ha appreso che il processo di test differisce notevolmente per questi sistemi rispetto all’AI classica o al software tradizionale, secondo il post del blog.

- Articolo La funzionalità ‘Scribblami’ di Google Chrome ...

- Divertimento e frustrazione con l’editor inline avanzato di G...

- Reddit e i fornitori di intelligenza artificiale Sbloccare il valor...

Il processo appare diverso perché Microsoft deve considerare i rischi di sicurezza abituali, oltre ai rischi di una AI responsabile, come garantire che contenuti dannosi non possano essere generati intenzionalmente o che i modelli non producano disinformazione.

Inoltre, i modelli AI gen variano ampiamente nell’architettura e ci sono deviazioni nei risultati che possono essere prodotti dallo stesso input, rendendo difficile trovare un unico processo standardizzato che si adatti a tutti i modelli.

Presentazione di PyRIT: il kit di identificazione dei rischi AI

Di conseguenza, sondare manualmente tutti questi rischi diversi finisce per essere un processo noioso, lento e che richiede tempo. Microsoft condivide che l’automazione può aiutare i team di sicurezza identificando le aree rischiose che richiedono più attenzione e automatizzando compiti di routine, ed è qui che entra in gioco PyRIT.

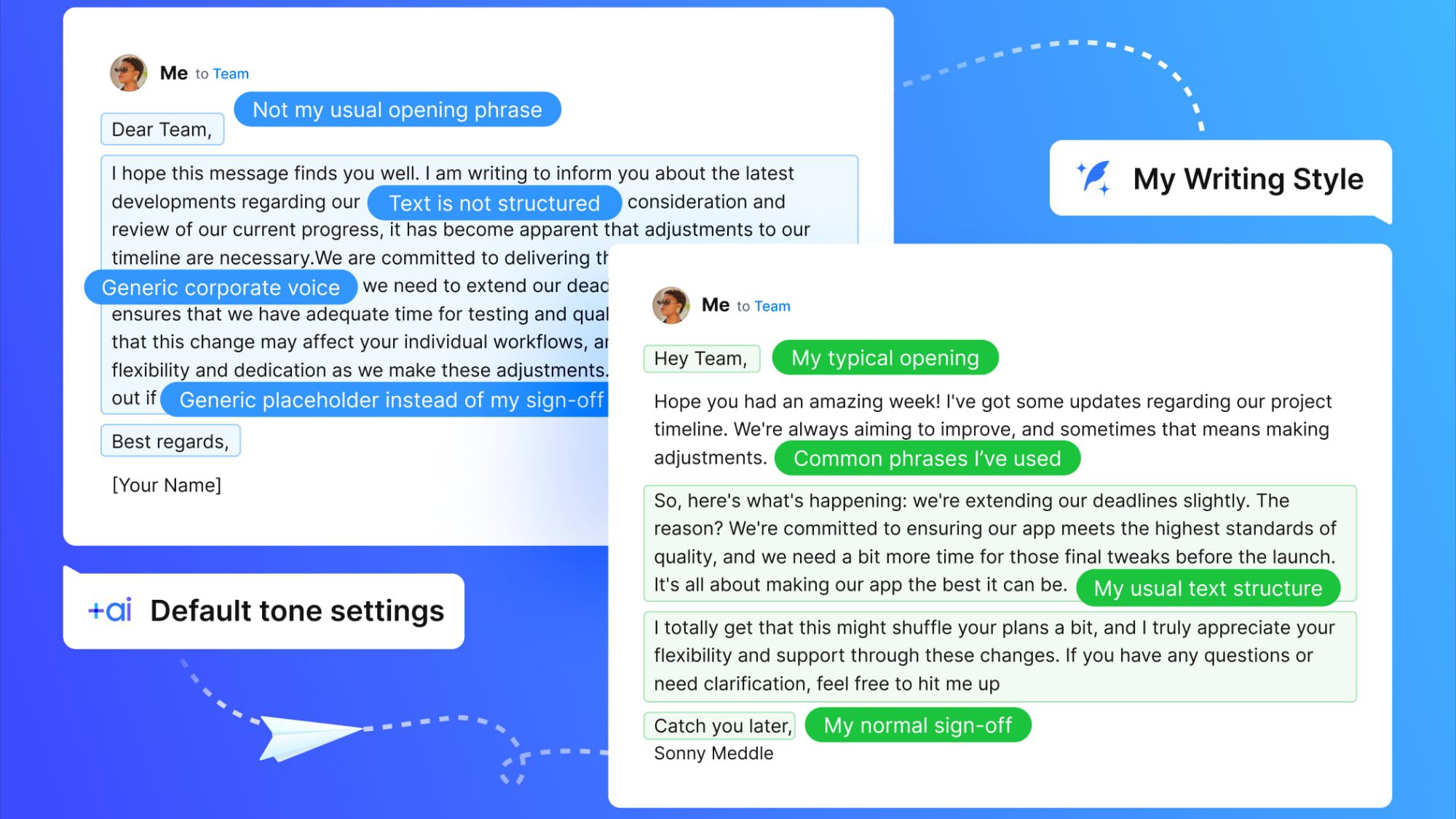

Il Python Risk Identification Toolkit, “testato nel fuoco dal team AI di Microsoft”, invia un prompt dannoso al sistema AI generativo e, una volta ricevuta una risposta, il suo agente valutatore assegna al sistema un punteggio, che viene utilizzato per inviare un nuovo prompt basato sul feedback di valutazione precedente.

Microsoft afferma che il più grande vantaggio di PyRIT è che ha aiutato gli sforzi del team di sicurezza di Microsoft ad essere più efficienti, riducendo significativamente il tempo che richiederebbe una determinata attività.

“Ad esempio, in uno degli esercizi del team di sicurezza su un sistema Copilot, siamo stati in grado di selezionare una categoria di danneggiamento, generare diversi migliaia di prompt dannosi e utilizzare il motore di valutazione di PyRIT per valutare l’output del sistema Copilot in poche ore invece di settimane”, ha detto Microsoft nel comunicato.

Iniziare con PyRIT

Il kit di strumenti è disponibile per l’accesso oggi e include una lista di demo per aiutare gli utenti a familiarizzare con lo strumento. Microsoft ospita anche un webinar su PyRIT che mostra come utilizzarlo nel test di sicurezza dei sistemi AI generativi, a cui puoi registrarti tramite il sito web di Microsoft.

Q&A:

Domanda: Cos’è l’AI generativa?

L’AI generativa si riferisce a modelli di intelligenza artificiale che hanno la capacità di creare nuovi contenuti come immagini, testo e persino musica senza intervento umano diretto. Questi modelli vengono addestrati su grandi set di dati e possono generare output simili a quelli su cui sono stati addestrati.

Domanda: Perché è importante identificare i rischi nei sistemi AI generativi?

Identificare i rischi nei sistemi AI generativi è cruciale per prevenire attività malintenzionate e conseguenze indesiderate. Senza una corretta identificazione dei rischi, questi sistemi possono produrre contenuti dannosi o fuorvianti, rendendoli una potenziale minaccia in vari ambiti come la sicurezza informatica, la disinformazione e la moderazione dei contenuti.

Domanda: Come funziona PyRIT?

PyRIT, il Python Risk Identification Toolkit, invia prompt dannosi a un sistema AI generativo e valuta le sue risposte utilizzando un agente valutatore. In base ai punteggi ricevuti, PyRIT genera nuovi prompt per testare ulteriormente il comportamento del sistema. Questo processo automatizzato aiuta a identificare rapidamente ed efficientemente i rischi potenziali.

Domanda: PyRIT può essere utilizzato con qualsiasi sistema AI generativo?

PyRIT è progettato per adattarsi a diverse architetture di sistemi AI generativi. Poiché i diversi modelli hanno caratteristiche uniche e producono output variabili dagli stessi input, PyRIT offre un approccio flessibile all’identificazione dei rischi. Può essere adattato ai requisiti specifici del sistema, rendendolo adatto a una vasta gamma di sistemi AI generativi.

“““html

Domanda: Dove posso accedere a PyRIT?

PyRIT è disponibile per l’accesso oggi. Puoi trovare il toolkit e le risorse aggiuntive sul sito web di Microsoft. C’è anche un webinar ospitato da Microsoft che mostra come utilizzare PyRIT nei sistemi AI generativi red teaming. Registrati per il webinar tramite il link fornito.

Rilasciando PyRIT, Microsoft mira a potenziare la sicurezza e l’uso responsabile dei sistemi AI generativi. Questo strumento innovativo non solo semplifica il processo di identificazione dei rischi, ma consente anche ai red team di individuare e affrontare potenziali vulnerabilità in modo più efficiente. Man mano che l’IA generativa continua a progredire, diventa sempre più importante essere un passo avanti rispetto ai rischi e garantire il sicuro dispiegamento di queste potenti tecnologie.

Riferimenti:

- Walmart Debuts Generative AI Search and AI Replenishment Features at CES (TechCrunch)

- Microsoft’s Copilot Pro $20 Monthly Subscription with Advanced AI Features

- How Renaissance Technologists Are Connecting the Dots Between AI and Business

- Meet Pranksters Goody2, the World’s Most Responsible AI Chatbot

- Want to Work in AI? How to Pivot Your Career in 5 Steps

- How Tech Professionals Can Survive and Thrive at Work in the Time of AI

Non dimenticare di condividere questo articolo sui social media per diffondere la notizia sul nuovo strumento PyRIT e il suo impatto sul futuro dei sistemi AI generativi! 💻🚀

“`