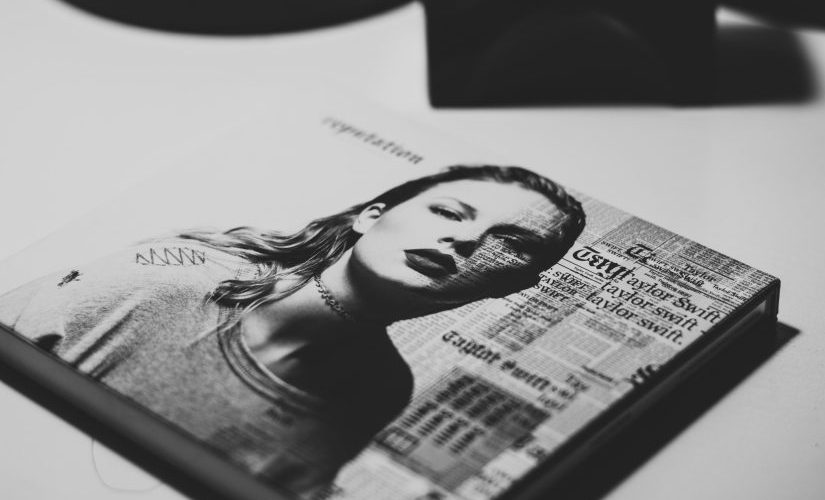

Microsoft risolve vulnerabilità dell’intelligenza artificiale dopo la controversia del deepfake di Taylor Swift

Microsoft risolve errore che consentiva al generatore di immagini AI di creare immagini oscene di Taylor Swift

Microsoft risolve la falla utilizzata nell’incidente di Taylor Swift.

Oh, Taylor Swift. Sai come fare notizia. Ma questa volta non è stata a causa di una nuova canzone di successo o di una relazione di alto profilo. No, è stato a causa di immagini generate dall’IA che sono diventate virali. E Microsoft, il gigante tecnologico, era nel mezzo di tutto questo.

La controversia si svela

Tutto è cominciato quando le persone hanno iniziato a utilizzare il generatore di immagini Designer AI di Microsoft per creare e condividere opere d’arte esplicite con protagonista Taylor Swift. Queste immagini si sono rapidamente diffuse sui social media, lasciando fan e non fan sconvolti e incuriositi. E, naturalmente, Internet se ne è divertito parecchio.

Ma come è successo tutto questo? Bene, il generatore di immagini Designer AI di Microsoft aveva una vulnerabilità che consentiva agli utenti di creare queste immagini volgari. Spostando alcune impostazioni, erano in grado di eludere le restrizioni del sistema. Era come trovare un passaggio segreto in un videogioco, solo che con molto più scandalo.

Microsoft assume la responsabilità

Mentre la controversia cresceva, Microsoft non ha evitato di affrontare il problema. Il CEO Satya Nadella ha pubblicamente riconosciuto che era loro responsabilità stringere le “guardie” attorno alle tecnologie basate sull’IA. E non potrei essere più d’accordo, Satya. Abbiamo bisogno di queste “guardie” per evitare che l’IA crei contenuti dannosi e potenzialmente pericolosi.

A seguito della dichiarazione di Nadella, Microsoft ha corretto la vulnerabilità. Sarah Bird, Responsabile dell’Ingegneria dell’IA Responsabile presso Microsoft, ha confermato che erano stati apportati i cambiamenti necessari. Tuttavia, Microsoft non ha potuto verificare se le immagini esplicite di Taylor Swift pubblicate su Twitter siano state create utilizzando il generatore di immagini Designer AI. È possibile che siano stati utilizzati altri metodi per generarle. 😮

- L’Atto per i mercati digitali dell’Unione Europea Faceb...

- Roomba è in guai?

- Tutto ciò che ti serve per il tuo set di vinili I migliori giradisc...

La battaglia contro i deepfake continua

Anche se Microsoft ha intrapreso azioni per affrontare questa specifica vulnerabilità, la battaglia contro i deepfake è ancora lungi dall’essere conclusa. Sbagliare i nomi famosi, utilizzare altre strumenti online o persino scaricare modelli da varie fonti può ancora portare alla creazione di contenuti espliciti e dannosi utilizzando l’IA. Questi strumenti e tecniche sono come Idra: taglia una testa e ne ricrescono altre due. 🐍

Allora, cosa possiamo fare? Beh, non spetta solo a Microsoft. Spetta a tutti noi: piattaforme tecnologiche, forze dell’ordine e la società nel suo insieme. Satya Nadella ha menzionato la necessità di un consenso globale e sociale su determinati norme. E io credo che possiamo farcela. Dobbiamo solo lavorare insieme per creare un ambiente online più sicuro.

Q&A: Quello che potresti chiederti

D: Microsoft può garantire che tutte le istanze di immagini esplicite generate dall’IA siano state eliminate?

R: Sebbene Microsoft abbia corretto la vulnerabilità che consentiva la creazione di immagini esplicite generate dall’IA utilizzando il loro strumento Designer, è difficile garantire l’eliminazione di tutto il contenuto simile. Esistono altri metodi e strumenti disponibili che possono ancora essere utilizzati per creare contenuti dannosi. È necessario un impegno continuo da parte di tutti gli attori interessati per affrontare efficacemente questa problematica.

D: Ci sono delle conseguenze legali per la creazione e la condivisione di immagini esplicite generate dall’IA?

R: La legalità della creazione e della condivisione di immagini esplicite generate dall’IA può variare a seconda della giurisdizione. In alcuni casi, potrebbe essere considerata diffamazione, molestia o addirittura violazione delle leggi sulla privacy. È importante consultare esperti legali e comprendere le leggi nel proprio paese o regione specifica.

D: Ci sono altre misure che le società tecnologiche possono adottare per prevenire un uso improprio dell’IA?

R: Assolutamente! Le società tecnologiche possono implementare linee guida e restrizioni più rigorose sugli strumenti basati sull’IA per prevenirne un uso improprio. Possono anche investire nello sviluppo di algoritmi avanzati di intelligenza artificiale in grado di rilevare e segnalare contenuti espliciti o dannosi. Inoltre, la collaborazione tra piattaforme tecnologiche, ricercatori e responsabili delle politiche è fondamentale per sviluppare strategie complete per affrontare questa problematica.

Il futuro dell’IA e della creazione di contenuti

La controversia dei deepfake di Taylor Swift serve come un campanello d’allarme per la comunità tecnologica. Sottolinea l’urgente necessità di uno sviluppo etico e responsabile dell’IA. Man mano che l’IA continua a evolversi e diventa sempre più accessibile, dobbiamo garantire che venga utilizzata per fini positivi e costruttivi.

Mentre Microsoft ha preso provvedimenti per chiudere questa particolare vulnerabilità, è un gioco costante di whack-a-mole quando si tratta di contenuti generati da intelligenza artificiale. Man mano che le tecnologie dell’IA avanzano, avanzano anche le tecniche utilizzate per manipolarle e abusarne. Ma questo non significa che dovremmo arrenderci. Invece, continuiamo a spingere per regolamentazioni, collaborazioni e ricerche in corso per stare un passo avanti a coloro che cercano di sfruttare il potenziale dell’IA per scopi dannosi.

Riferimenti

- Google-Backed Jio Platforms Valued Over $100 Billion+ – Scopri di più sulla valutazione di Jio Platforms.

- La società di media in streaming Plex raccoglie nuovi fondi – Ottieni informazioni sull’avanzamento della raccolta fondi di Plex.

- Mirantis nomina un nuovo CEO – Scopri i cambiamenti nella leadership di Mirantis.

📺 Guarda il video: Il CEO di Microsoft risponde ai deepfake di Taylor Swift

Deanna Ritchie, responsabile editoriale di ENBLE, ha contribuito a questo articolo.

Deanna Ritchie è un’editor con oltre 20 anni di esperienza nella gestione e sviluppo dei contenuti. Ha lavorato per varie pubblicazioni, tra cui Entrepreneur Media e Startup Grind. La sua competenza in tecnologia e media le consente di fornire analisi e commenti illuminanti su argomenti di tendenza. È possibile saperne di più su Deanna qui.

📚 Riferimenti

- Crediti immagine in primo piano: Rosa Rafael; Unsplash

- Articolo originale