Hugging Face dà agli utenti il potere di rilevare deepfake

Scopri la gamma di strumenti per rilevare i contenuti generati da intelligenza artificiale

Hugging Face combatte gli AI deepfake: presentazione di Provenance, Watermarking e Deepfake Detection Collection! 😮🔍💦

In un mondo in cui gli AI deepfake stanno diventando sempre più diffusi, Hugging Face, l’azienda nota per lo sviluppo di strumenti di apprendimento automatico e l’ospitalità di progetti di intelligenza artificiale, si schiera contro la disinformazione e la violazione del copyright. 🛡️🎨🎥

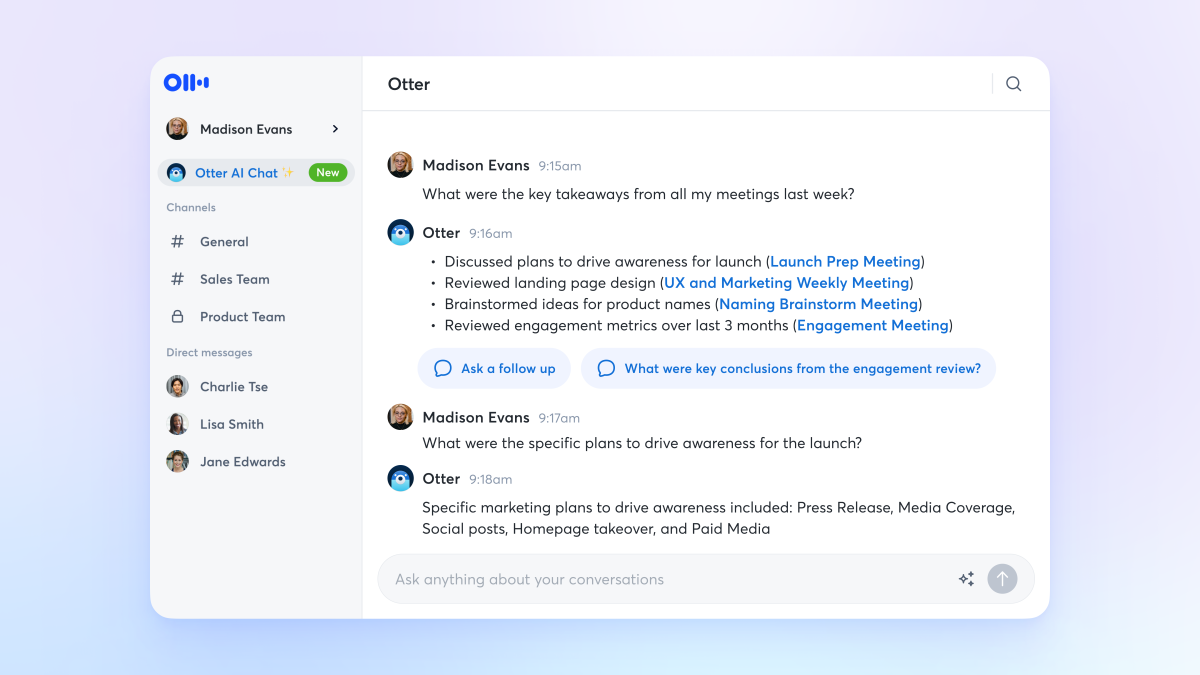

Recentemente, Hugging Face ha lanciato una collezione chiamata “Provenance, Watermarking and Deepfake Detection”, progettata per fornire risorse per lo sviluppo etico dell’intelligenza artificiale. 📚🤝 Questa collezione include vari strumenti in grado di incorporare filigrane in file audio, modelli di apprendimento linguaggio linguaggio, immagini e rilevare deepfake. 😱💧🕵️♀️

La diffusa disponibilità della tecnologia AI generativa ha dato origine a una preoccupante proliferazione di deepfake audio, video e immagini. Ciò non solo contribuisce alla diffusione di disinformazione, ma costituisce anche una minaccia all’integrità delle opere creative attraverso il plagio e la violazione del copyright. La gravità di questo problema è rispecchiata nel recente decreto esecutivo sull’intelligenza artificiale del presidente Biden, che impone l’apposizione di filigrane al contenuto generato dall’IA. 😮📃

I principali attori dell’industria tecnologica, come Google e OpenAI, hanno riconosciuto l’importanza dell’apposizione di filigrane e hanno lanciato i propri strumenti per incorporare filigrane nelle immagini create dai loro modelli AI generativi. È evidente che l’apposizione di filigrane è cruciale per proteggere le opere creative e individuare informazioni fuorvianti. 🖼️💦

L’annuncio di queste preziose risorse è stato fatto da Margaret Mitchell, ricercatrice e capo scienziata dell’etica presso Hugging Face, nonché ex dipendente di Google. Mitchell, insieme ad altri professionisti dedicati alla promozione dell’impatto sociale, ha creato questa collezione per affrontare la crescente preoccupazione legata ai contenuti “falsi” generati dall’IA. 🧑💻🌍

- ChatGPT di OpenAI introduce la funzione di memoria interazioni pers...

- OpenAI si trova in una battaglia legale per violazione del copyrigh...

- 🚀 Il Futuro di ChatGPT-5 Capacità Migliorate e Sviluppi Entusiasmanti

Strumenti essenziali per fotografi, designer e creatori di contenuti! 📸✨

La collezione offre una serie di strumenti specificamente progettati per le esigenze di fotografi e designer. Questi strumenti proteggono il loro lavoro dall’essere utilizzato per addestrare modelli di intelligenza artificiale, preservando al contempo la proprietà e l’integrità. Ad esempio, Fawkes è uno strumento che “avvelena” o limita l’uso di software di riconoscimento facciale su foto disponibili pubblicamente, salvaguardando la privacy delle persone. 😷📷

Altri strumenti come WaveMark, Truepic, Photoguard e Imatag sono progettati per prevenire l’uso non autorizzato di opere audio o visive incorporando filigrane che possono essere rilevate da software specifici. È particolarmente notevole che Photoguard abbia sviluppato uno strumento che rende un’immagine “immune” alla modifica di IA generativa, fornendo un ulteriore livello di protezione. 🚫🎨

Le filigrane non sono infallibili, ma rappresentano un passo nella giusta direzione! 🚀🔒

Anche se l’apposizione di filigrane ai media generati dall’IA è un passo essenziale per proteggere le opere creative e individuare informazioni fuorvianti, è importante riconoscere che non è infallibile. Spesso le filigrane incorporate nei metadati vengono automaticamente rimosse quando vengono caricate su siti di terze parti come i social media. Inoltre, gli utenti malintenzionati possono aggirare le filigrane facendo uno screenshot di un’immagine con filigrana. Tuttavia, nonostante queste sfide, gli strumenti condivisi da Hugging Face sono indubbiamente preziosi e offrono una difesa significativa contro i deepfake. 💪🤳

🤔 Domande e Risposte

D: Come possono i deepfake generati dall’IA influenzare la società? I deepfake generati dall’IA hanno il potenziale di arrecare un significativo danno a individui e alla società nel suo complesso. Possono essere utilizzati per diffondere disinformazione, manipolare l’opinione pubblica e facilitare frodi o impersonazioni. È fondamentale disporre di strumenti e misure efficaci per rilevare e contrastare gli effetti dannosi dei deepfake.

D: Le filigrane possono garantire la protezione delle opere creative? Sebbene le filigrane siano un’importante misura di sicurezza, non sono infallibili. Algoritmi AI avanzati e avversari esperti possono comunque trovare modi per rimuovere o manipolare le filigrane. Pertanto, è essenziale affiancare ai metodi di filigranatura altre misure di sicurezza per garantire la protezione delle opere creative.

D: Quali sono alcuni sviluppi futuri nel campo della rilevazione dei deepfake? Man mano che la tecnologia dei deepfake continua a progredire, anche gli strumenti e i metodi per la rilevazione dei deepfake si stanno evolvendo. Un approccio promettente è l’uso di algoritmi avanzati di apprendimento automatico appositamente progettati per rilevare i media manipolati. Inoltre, le collaborazioni tra aziende tecnologiche, ricercatori e responsabili delle politiche sono cruciali per affrontare in modo efficace le sfide poste dai deepfake.

🔍📈🚀 Impatto e Sviluppi Futuri

Il rilascio della collezione “Provenience, Watermarking e Deepfake Detection” di Hugging Face segna una tappa importante nella lotta contro i deepfake di intelligenza artificiale. Essa mette in mostra il crescente riconoscimento della necessità di uno sviluppo etico nel campo dell’IA e evidenzia gli sforzi compiuti dai leader del settore per proteggere le opere creative e contrastare la disinformazione.

Guardando al futuro, possiamo aspettarci continui progressi nella tecnologia di rilevazione dei deepfake. È cruciale che le aziende, i ricercatori e i policymaker lavorino insieme per rimanere un passo avanti agli attori malintenzionati. Favorire la collaborazione e investire nella ricerca e nello sviluppo può consentire di creare un ambiente digitale più sicuro per tutti. 🌐💡

📚 Riferimenti: – OpenAI sta aggiungendo filigrane alle immagini di ChatGPT create con DALL-E 3 – I deepfake generati da IA nelle telefonate di Biden provenivano da un’azienda del Texas – Cosa devono dire i genitori ai loro figli riguardo ai deepfake espliciti – Il nuovo generatore di video di Google è fantastico, ma che ne è dei deepfake? – Intelligenza Artificiale: Andare Oltre l’Artificial General Intelligence

✨📢 Condividi le tue opinioni!

Hai mai sperimentato o preoccupato dell’impatto dei deepfake di intelligenza artificiale? Credi che i filigrane e altre misure di sicurezza possano proteggere efficacemente le opere creative? Condividi le tue opinioni e discutiamone! 💬💭💻

Non dimenticare di condividere questo articolo sui social media per contribuire a sensibilizzare sull’importanza di combattere i deepfake di intelligenza artificiale! Insieme, possiamo fare la differenza! 🌐🤝🚀💦