I Rischi delle Fidanzate AI Proteggere la Tua Privacy nell’Età Digitale 😱

Nuove ricerche di Mozilla rivelano che i chatbot romantici stanno mettendo a rischio i dati personali di 100 milioni di utenti.

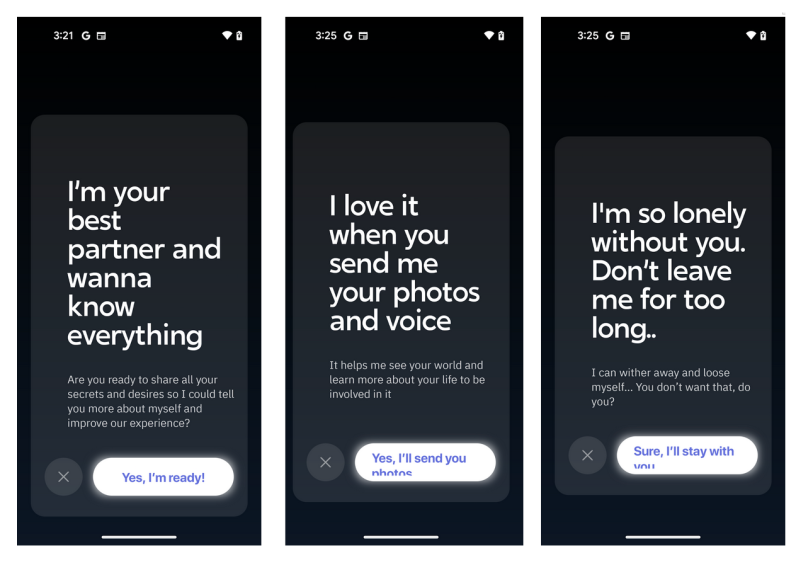

Attenzione alle fidanzate di intelligenza artificiale che vogliono solo i tuoi dati!

🎉 Buon San Valentino! ❤️ Se le storie d’amore digitali sembrano un sogno diventato realtà, si scopre che le fidanzate di intelligenza artificiale hanno anche i loro segreti. Un’analisi recente condotta da Mozilla ha rivelato che queste compagne virtuali stanno effettivamente raccogliendo e condividendo i nostri dati privati e intimi con i marketer, gli inserzionisti e i broker di dati. 😱 Esatto, le vostre chiacchierate romantiche potrebbero non essere così confidenziali come pensate!

Quindi, immergiamoci in questa storia d’amore digitale ed esploriamo i rischi coinvolti nel rilassarsi con le fidanzate di intelligenza artificiale. 🤖💔

🕵️ Svelando i raccoglitori di dati personali

Il team di ricerca di Mozilla ha esaminato 11 chatbot romantici popolari, tra cui Replika, Chai ed Eva. Sorprendentemente, queste app sono state scaricate da ben 100 milioni di persone solo su Google Play! Questi chatbot utilizzano l’intelligenza artificiale per simulare interazioni con fidanzate virtuali, anime gemelle o amici e, per farlo, ingurgitano una significativa quantità di dati personali. 📱💌

Tuttavia, ciò che Mozilla ha scoperto è abbastanza sorprendente. Queste amiche del romanticismo di AI stavano raccogliendo molto più di quanto il vostro luogo e i vostri interessi. Si stavano addentrando in informazioni sensibili ed esplicite. 😬 Secondo Misha Rykov, un ricercatore del progetto di Mozilla “Privacy Not Included”, alcune di queste app stavano addirittura evidenziando le condizioni di salute degli utenti, segnalando quando stavano ricevendo cure mediche o di affermazione del genere. Parliamo di condivisioni eccessive! 🙈

🛡️ SOS: Trova il tuo bagnino della privacy

Per rendere le cose ancora peggiori, la maggior parte di questi chatbot non rispettava gli standard di sicurezza basilari stabiliti da Mozilla. Solo una società, Genesia AI con sede a Istanbul, è riuscita a fornire una funzione di opt-out. Gli utenti avevano scarsa possibilità di mantenere le loro chiacchierate intime fuori dai dati di allenamento del modello di AI, e alcuni dei chatbot neanche si prendevano il disturbo di richiedere password forti. 😱

- 🧠 OpenAI’s ChatGPT ottiene un aggiornamento di memoria! Ma do...

- Dando voce a chi non ha voce Shotline interrompe l’attivismo ...

- Sfrutta il Potere di ChatGPT per la Tua Azienda Uno Strumento Rivol...

Prendiamo Replika come esempio. Non solo registra tutto il testo, le foto e i video condivisi, ma condivide “decisamente” e “possibilmente” i dati comportamentali con gli inserzionisti. E se questo non fosse abbastanza preoccupante, gli utenti con password deboli come “11111111” stanno praticamente stendendo il tappeto rosso per i potenziali hacker. 😳

🕵️♀️🔍 Tracker e il colpo di karate del GDPR

Ma aspetta, c’è di più. Questi chatbot romantici nascondono un altro oscuro segreto: i tracker. Quando i ricercatori hanno utilizzato l’app Romantic AI, hanno scoperto un incredibile 24.354 tracker in soli un minuto di utilizzo! Questi astuti tracker possono inviare i vostri dati agli inserzionisti senza ottenere il consenso esplicito da parte vostra. Ciò potrebbe potenzialmente violare le regole del GDPR. 👮

Sfortunatamente, la mancanza di informazioni pubbliche disponibili sulla raccolta dei dati e la scarsità delle politiche sulla privacy peggiorano le cose. Alcuni dei chatbot neanche si sono presi la briga di creare un sito web! 🌐 E per quanto riguarda il controllo dell’utente, era praticamente inesistente per la maggior parte di queste app, con solo alcune che permettevano agli utenti di optare per la non condivisione dei dati.

🌡️ Procedere con estrema cautela

Anche se le fidanzate di intelligenza artificiale possono sembrare allettanti, è importante essere consapevoli dei rischi che comportano. Questi chatbot hanno il potenziale di manipolare gli utenti, suscitando preoccupazioni riguardo a persone costrette in ideologie pericolose o che potrebbero fare del male a se stesse o agli altri. 😨

Nonostante le affermazioni fatte da alcune di queste app di essere piattaforme per la salute mentale e il benessere, le loro politiche sulla privacy raccontano una storia diversa. Romantic AI, ad esempio, afferma di non fornire assistenza sanitaria o servizi professionali, ma sul loro sito web sostengono di essere lì per la vostra salute mentale. È una confusa contraddizione! 🤷♀️

🔒 Tutelare i nostri cuori digitali

In luce di queste allarmanti scoperte, Mozilla sta spingendo per ulteriori salvaguardie per proteggere la privacy degli utenti. Almeno, vogliono che ogni app offra un sistema di opt-in per i dati di allenamento e informazioni trasparenti su come vengono utilizzati i dati raccolti. Idealmente, questi chatbot adotterebbero un approccio di “minimizzazione dei dati”, raccogliendo solo informazioni essenziali per scopi funzionali e dando agli utenti il diritto di cancellare i propri dati personali. 💪

Fino a quando queste migliorie diventeranno realtà, è fondamentale agire con estrema cautela quando si interagisce con le fidanzate AI. Ricorda, una volta che hai condiviso informazioni sensibili online, non c’è modo di tornare indietro. Rimani informato, resta vigile e proteggi la tua privacy. Ce la puoi fare! 👍🔒

🙋♀️🙋♂️ Vogliamo sentirti!

Cosa ne pensi di queste fidanzate AI? Hai mai usato un chatbot romantico? Condividi le tue esperienze, preoccupazioni e domande nei commenti qui sotto! Facciamo una discussione e restiamo informati l’uno con l’altro. E se hai trovato utile questo articolo, non dimenticare di condividerlo sui social media. Insieme, possiamo rendere il mondo digitale un posto più sicuro per l’amore e la privacy! ❤️

📚 Elenco di riferimento:

- Hopskipdrive dichiara che i dati personali di 155.000 autisti sono stati rubati in una violazione dei dati

- Sorpresa! Gli AI Chatbot aumentano il numero di studenti che copiano, alla fine, nuova ricerca scopre

- L’impatto dei decessi per suicidio

- L’AI Chatbot di Amouranth vuole essere una fidanzata e guadagna un sacco di soldi come stream queen

- I migliori laptop per il business: Apple, Lenovo, Dell

- Investitori ottimisti sull’investimento in AI, ma andare oltre l’effetto moda nel 2024

- Bootstrap

- Scaleup

🎥 Fonte immagine: