AWS facilita lo sviluppo di app AI per le aziende | ENBLE

AWS semplifica lo sviluppo di app AI aziendali | ENBLE

Il futuro dell’intelligenza artificiale sta rapidamente diventando un’esperienza pronta all’uso che le aziende possono personalizzare in base alle loro esigenze specifiche. Esperienze di chat ottimizzate che vanno ben oltre le domande e risposte e strumenti per creare applicazioni di intelligenza artificiale senza mesi di sviluppo di codice potrebbero essere il prossimo passo al di fuori dell’introduzione di nuovi plugin ed estensioni.

Strumenti più comuni, come ChatGPT per le informazioni e Midjourney per le immagini, si basano su dati pubblici e codifica coerente degli sviluppatori per creare un prodotto finale. Nel frattempo, Amazon Web Services (AWS) si impegna a creare intelligenza artificiale generativa che non solo è più produttiva e facile da navigare, ma anche unica in termini di dati e sicurezza dei dati per le aziende che utilizzano i suoi strumenti.

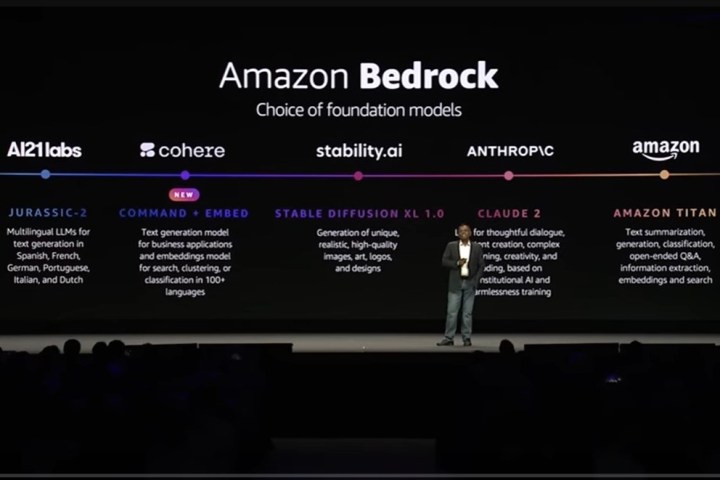

Il marchio sta utilizzando piattaforme come Amazon Bedrock per ritagliarsi uno spazio unico nel nuovo mercato dell’intelligenza artificiale. Il suo centro principale è disponibile da aprile e ospita diversi ciò che chiama Foundation Models (FM). AWS ha inizialmente addestrato queste API di base e offre alle organizzazioni le funzionalità standard di intelligenza artificiale desiderate. Le organizzazioni possono combinare le FM preferite e continuare a sviluppare app, aggiungendo i propri dati proprietari per le loro esigenze uniche.

“Come fornitore, addestriamo questi modelli su un ampio corpus di dati. Una volta che il modello è addestrato, c’è un punto di taglio. Ad esempio, gennaio 2023, quindi il modello non ha più informazioni dopo quel punto, ma le aziende vogliono dati, che sono privati”, ha detto Atul Deo, Product and Engineering General Manager di Amazon Bedrock, a ENBLE.

Ogni azienda e i modelli di foundation che utilizza saranno diversi, quindi ogni applicazione risultante sarà unica in base alle informazioni che le organizzazioni forniscono a un modello. Le FM sono già modelli di base. Utilizzare quindi informazioni open-source per popolare i modelli può rendere le applicazioni ripetitive tra le aziende. La strategia di AWS offre alle aziende l’opportunità di rendere le loro app uniche introducendo i propri dati.

- Le cifre di vendita delle GPU mostrano che AMD è il suo peggior nem...

- 8 modi facili per fare screenshot in Windows 10 e 11

- Google inizia a avvisare gli utenti riguardo alle potenziali cancel...

“Vuoi anche poter porre domande al modello e ottenere risposte, ma se può rispondere solo a domande su dati pubblici obsoleti, non è molto utile. Vuoi poter passare le informazioni rilevanti al modello e ottenere le risposte pertinenti in tempo reale. Questo è uno dei problemi principali che risolve”, ha aggiunto Deo.

Modelli di foundation

I diversi modelli di foundation supportati su Amazon Bedrock includono Amazon Titan, oltre a modelli dei fornitori Anthropic, AI21Labs e StabilityAI, ognuno affrontando importanti funzioni nell’ambito dell’intelligenza artificiale, dall’analisi del testo, alla generazione di immagini, alla generazione multilingue e ad altre attività. Bedrock è una continuazione dei modelli pre-addestrati che AWS ha già sviluppato sulla sua piattaforma Stagemaker Jumpstart, che ha contribuito a diversi FMs pubblici, tra cui Meta AI, Hugging Face, LightOn, Databricks e Alexa.

AWS ha anche recentemente annunciato nuovi modelli di Bedrock del marchio Cohere durante il suo summit AWS a fine luglio a New York City. Questi modelli includono Command, che è in grado di eseguire sintesi, copywriting, dialogo, estrazione di testo e risposta alle domande per applicazioni aziendali, e Embed, che può completare ricerche di cluster e classificare compiti in oltre 100 lingue.

Il vicepresidente del machine learning di AWS, Swami Sivasubramanian, ha dichiarato durante la presentazione principale del summit che i FMs sono a basso costo, a bassa latenza, destinati a essere personalizzati in modo privato, con dati crittografati e non vengono utilizzati per addestrare il modello di base originale sviluppato da AWS.

Il marchio collabora con diverse aziende che utilizzano Amazon Bedrock, tra cui Chegg, Lonely Planet, Cimpress, Philips, IBM, Nexxiot, Neiman Marcus, Ryanair, Hellmann, WPS Office, Twilio, Bridgewater & Associates, Showpad, Coda e Booking.com.

Agenti per Amazon Bedrock

AWS ha anche introdotto il tool ausiliario, Agenti per Amazon Bedrock, al suo summit, che amplia le funzionalità dei modelli di foundation. Rivolto alle aziende per una moltitudine di casi d’uso, Agents è un’esperienza di chat aumentata che assiste gli utenti oltre la semplice domanda e risposta dei chatbot standard. È in grado di eseguire attivamente compiti in base alle informazioni su cui è ottimizzato.

AWS ha fornito un esempio di come funziona bene in uno spazio commerciale. Supponiamo che un cliente al dettaglio voglia scambiare un paio di scarpe. Interagendo con Agent, l’utente può specificare che desidera effettuare un cambio di scarpe dalla taglia 8 alla taglia 9. Gli agenti chiederanno il numero dell’ordine. Una volta inserito, gli agenti saranno in grado di accedere all’inventario al dettaglio dietro le quinte, comunicare al cliente che la taglia richiesta è disponibile e chiedere se desiderano procedere con lo scambio. Una volta che l’utente dice sì, gli agenti confermeranno che l’ordine è stato aggiornato.

“Tradizionalmente fare ciò richiederebbe molto lavoro. I vecchi chatbot erano molto rigidi. Se dicevi qualcosa qua e là e non funzionava, avresti detto lasciami parlare con l’agente umano”, ha detto Deo. “Ora, perché i grandi modelli di linguaggio hanno una comprensione molto più ricca di come parlano gli esseri umani, possono intraprendere azioni e utilizzare i dati proprietari di un’azienda.”

Il marchio ha anche fornito esempi di come una compagnia di assicurazioni possa utilizzare gli agenti per presentare e organizzare le richieste di assicurazione. Gli agenti possono persino assistere il personale aziendale con compiti come cercare la politica aziendale sul PTO o pianificare attivamente quel periodo di ferie, con uno stile di prompt AI ormai comunemente conosciuto, come ad esempio “Puoi presentare il PTO per me?”

Gli agenti catturano in particolare come i modelli fondamentali consentano agli utenti di concentrarsi sugli aspetti dell’IA che sono più importanti per loro. Senza dover passare mesi a sviluppare e addestrare un singolo modello di linguaggio alla volta, le aziende possono dedicare più tempo a ottimizzare le informazioni importanti per le proprie organizzazioni in Agenti, garantendo che siano aggiornate.

“Puoi perfezionare un modello con i tuoi dati proprietari. Mentre viene effettuata la richiesta, desideri il meglio e il più recente”, ha detto Deo.

Poiché molte aziende nel complesso continuano a spostarsi verso una strategia più orientata al business per l’IA, l’obiettivo di AWS sembra semplicemente essere quello di aiutare i marchi e le organizzazioni a far funzionare le loro app e servizi integrati con l’IA più presto. Ridurre il tempo di sviluppo delle app potrebbe portare a una serie di nuove app di intelligenza artificiale sul mercato, ma potrebbe anche comportare l’aggiornamento di molti strumenti comunemente utilizzati che ne hanno bisogno.